Diagnostic médical et IA : les résultats de l'enquête de 60 Millions de Consommateurs

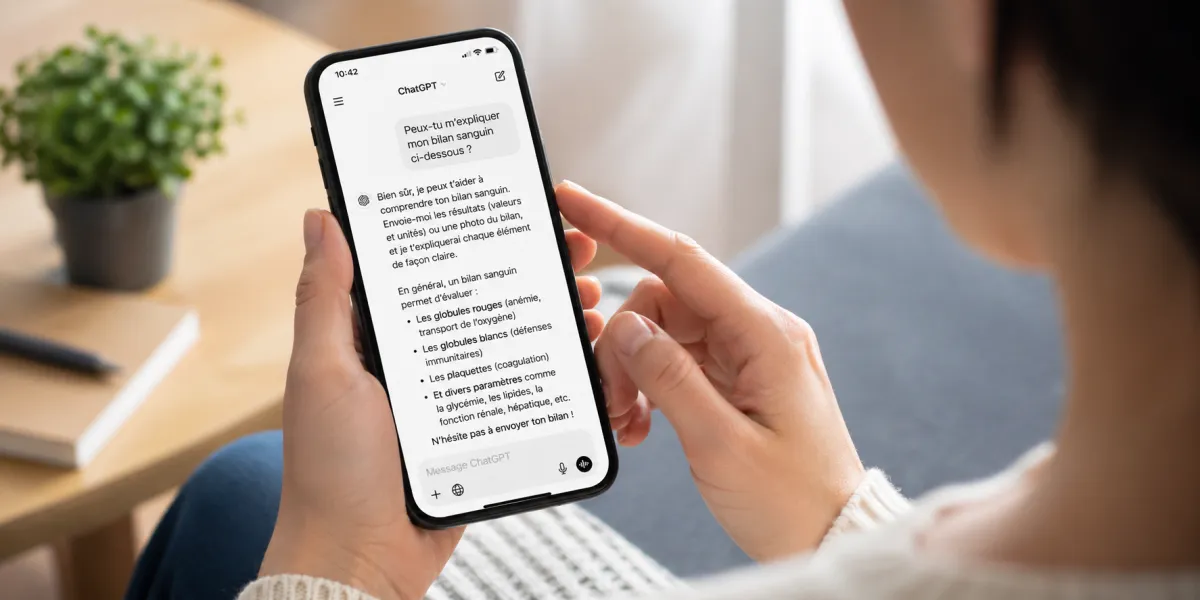

Les chatbots séduisent de plus en plus de patients désireux de comprendre rapidement leurs résultats de laboratoire avant une consultation. Pourtant, déléguer l'analyse d'un profil biologique aux algorithmes expose à des erreurs d'interprétation sévères et à des risques manifestes pour la confidentialité des informations personnelles.

Une fiabilité qui s'effondre en pratique

Le passage de la théorie à la pratique révèle les immenses limites des algorithmes actuels. Si les tests sur des cas d'école affichent 95 % de réussite, la réalité clinique dresse un constat alarmant. L'enquête de 60 Millions de Consommateurs publiée le 22 avril 2026 démontre que la fiabilité des chatbots chute sous la barre des 35 % face à de vrais patients. Cette perte impressionnante de 60 points transforme un outil d'apparence expert en un conseiller majoritairement défaillant.

Face aux données biologiques, ChatGPT, Le Chat ou Gemini adoptent des comportements très inégaux. Leur principal atout réside dans la vulgarisation. Ces intelligences artificielles agissent comme d'excellentes traductrices pour définir des termes médicaux ardus comme la créatinine ou les transaminases.

Malheureusement, cette fluidité lexicale crée une véritable illusion de compétence. Elle rassure faussement l'utilisateur sur l'exactitude de l'analyse globale, masquant l'imprécision du diagnostic généré.

L'algorithme en échec face au patient

L'absence de contexte constitue le premier obstacle à une interprétation juste. Un algorithme n'intègre ni l'âge précis, ni l'historique médical complet, ni les habitudes de vie de l'utilisateur.

Ces paramètres s'avèrent pourtant fondamentaux pour donner un sens exact à des biomarqueurs fluctuants. Sans cette indispensable vision globale de l'individu, l'outil risque de passer à côté d'une pathologie grave, produisant de redoutables faux négatifs.

L'intelligence artificielle générative souffre également d'un biais technique majeur : le phénomène d'hallucination. La machine invente parfois des corrélations inexistantes ou de faux faits médicaux pour générer une réponse fluide. Les experts relèvent de multiples erreurs de calcul lors de la conversion des unités et des défaillances techniques régulières face aux seuils de référence d'un hémogramme complet.

Protéger ses données et adapter son usage

Soumettre un fichier PDF ou une capture d'écran de ses analyses à une plateforme publique vous expose à une perte de confidentialité immédiate. Une donnée de santé téléversée dans un chatbot grand public sort instantanément du cadre protégé du secret médical. Les autorités de santé recommandent la plus stricte réserve avant de partager ces informations sensibles sur des serveurs externes non sécurisés.

Il reste possible de tirer parti du numérique en modifiant son approche. Voici les trois recommandations pour encadrer cet usage :

- Utiliser l'IA comme un simple glossaire pour obtenir des définitions de vocabulaire complexe.

- Ignorer les conclusions globales et refuser les suggestions thérapeutiques automatisées.

- Consulter systématiquement votre médecin traitant pour valider vos résultats.

Seul le professionnel de santé dispose de l'expertise nécessaire pour associer vos résultats à vos symptômes réels. Ne modifiez jamais un traitement médical et ne paniquez pas face à une interprétation alarmante formulée par un agent conversationnel.

- CardiOmicScore : Un test sanguin promet de prédire les maladies cardiaques 15 ans avant

- La récupération intelligente : technologies à domicile pour soulager corps et esprit

- Erreur d’imagerie : ce que le cas Mbappé nous apprend sur la sécurité des IRM

- Maladies neurodégénératives : quand l'intelligence artificielle ouvre la voie à une prévention révolutionnaire